Digital Archives

Geleceği kodla inşa edenlerin not defteri.

El Kontrolü ile Mouse Kullanmak - Kamera - Python

Elinizle havada işaretler yaparak bilgisayarınızın faresini kontrol edebileceğiniz harika bir Python projesi!

N...

Detaylı Sistem Bilgisi Görüntüleyici

pip install psutil pyperclip

import platform

import psutil

import wmi

import tkinter as tk

from tkinter import m...

Constant FILTER_SANITIZE_STRING is deprecated hatası çözümü

FILTER_SANITIZE_STRING filtresi PHP 8.1 ve üstü sürümlerde kaldırıldı. Bunun yerine FILTER_SANITIZE_FULL_SPECIAL_...

Txt Dosyasını Veritabanı Olarak Kullanmak

<?php

// Verileri okuyan ve şifresini çözen fonksiyon

function oku($fileName, $secretKey, $encryptionMethod)

{

...

Php ve Yapay Zeka İle Kullanıcı Adı Kontrolü. Prompt Tasarım by Tayfun Erbilen

<?php

class ChatApp {

private $model= "gpt-3.5-turbo-0301";

private $messages= array();

public $api_...

Php Twitter Api v2 ve Oauth1.0a Sınıfı - Tweet API 2023

<?php

session_start();

define("CONSUMER_KEY", "iybjF4ucDqQ9VeSJm0....");

define("CONSUMER_SECRET", "xhLbOYuQyGSE2Dyr...

Windows 11 Paint Kapanmama Problemi

Windows 11 de Paint uygulaması kapanmıyor ise ESC tuşuna bastıktan sonra kapatabilirsiniz.

Php ile Chatgpt yapay zeka sohbet botu sorgulama ve geçmişi hafızaya alarak cevap verme

<?php

class ChatApp {

private $model;

private $messages;

public $api_key;

public function __construc...

Xampp Php 7.4 x86 32bit VC15

XAMPP for Windows 7.4.29 sürümü 64 bit olduğundan sizlere 32 bitlik sürümünü hazırladım.

...

Mysql Sıradaki Atlanmış Boş Otomatik Id Numaralarını Bulma

Bazen auto increment kullanırken aradan veriler silinebiliyor. Bu şekilde bir kullanım ile tekrar boş idleri doldur...

Phpmyadmin Binary Veriyi Utf8 Görüntüleme

$result = bin2hex($content);

$result = pack('H*', $result);

$result = mb_convert_encoding($result, "UTF-8",&q...

Phpmyadmin root şifresi oluşturma

Phpmyadmin sql kısmından aşağıdaki kodu girdiğiniz zaman şifreniz mysql olacaktır.

SET PASSWORD FOR 'root'@'...

Deprecated Non-static method should not be called statically (Php 5'ten 7'ye)

Php sürüm 5 te sınıf içerisinde kullandığınız statik fonksiyonları php sürrüm 7 ve 8 de çalıştırmak ist...

Php Imap E-Mail Dosya Eklerini İndirme

Aşağıdaki kod ile gelen kutunuzda bulunan tüm e-maillerdeki dosya eklerini toplu olarak indirebilirsiniz. Dilerseni...

Php ile Whatsapp grupta kim kaç mesaj atmış uygulaması

<?php

header('Content-Type: text/html; charset=utf-8');

$fh = fopen('wp.txt','r');//whatsapp grup mesaj yedeği dos...

Php ile Lynch-Bell Sayılarını Bulmak (Algoritmik Çözüm)

<?php

error_reporting(0);//sıfıra bölme hatası bastırma

//Php ile Lynch-Bell Sayılarını Bulmak

//açıklay...

Mysql 1364 Field doesn't have a default value hatası çözümü

Phpmyadmin güncellemesi ile birlikte bu hatayı alanlar uyarıda geçen tabloya tıkladıktan sonra Yapı menüsünden...

Php Base Url Fonksiyonu

Php config sayfanıza aşağıdaki kodu ekleyip html sayfanızdaki url ve linklerin başına bu fonksiyonu ekleyebilirs...

`Sunucunuz PHP 5.4.24 sürümü kullanıyor fakat WordPress 5.x.x en az 5.6.20 gerektirir` Hatası Çözümü

$required_php_version = '5.6.20';

wp-includes/version.php satır 37 de yukarıdaki 5.6.20 kısmını değiştirerek ...

Resim Yükleme ve Boyutlandırma Sınıfı

<?php

header('Content-Type: text/html; charset=utf-8');

class resimYukleyici{

public $isim;

public $tip;

publ...

HTML Liste Sınıfı

<?php

header('Content-Type: text/html; charset=utf-8');

class HTML_Liste {

var $link,$link_baslik,$font,$renk,$ti...

Saat Farkı Ekleme Çıkarma Sınıfı

<?php

class zamanDamgasi {

var $deger = '';

var $fark = 0;

var $bicim="d.m.Y H:i:s";

function zamanDamgas...

Mcrypt ile Şifreleme Sınıfı

<?php

header('Content-Type: text/html; charset=iso-8859-9');

class SifreleCoz {

var $anahtar;

var $veri;

var ...

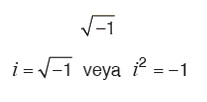

Karmaşık Sayılar Hesaplama Sınıfı

<?php

class Z{

function Z($x = "", $y = "", $kartezyen = 0, $radyan = 0 ){

if( $radyan ){

$this->radyan ...

Benzersiz Oturum Kimliği Oluşturma Sınıfı

<?php

class benzersizOturumKimligi{

var $ip;

var $karaktersil;

function benzersizOturumKimligi($mod = "normal"){...

Uzak Sunucu Dosya İstatiktikleri Sınıfı

<?php

class UzakDosyaKontrol {

var $hata;

var $hatano;

var $hatamesaj;

var $sunucu;

var $tarih;

var $boy...

Blok Oluşturma Süresi

<?php

class Damgalar {

var $tdizi = array();

var $i = 0;

function Damgalar($yorum = '') {

$this->sureEkl...

Yılın Kaçıncı Haftasındayız

<?php

class Haftabul {

var $damga;

function __construct($tarih){

if (is_int ($tarih))

$this->damga = $...

Türk Parasının Yazıyla Okunuş Sınıfı

<?php

class paraOku{

public $bir = array("","bir","iki","üç","dört","beş","altı","yedi","sekiz","dokuz");

p...

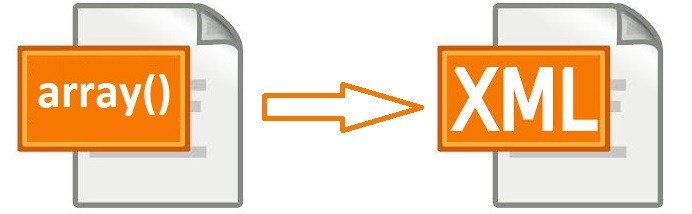

Diziyi Xml'ye Çevirme

<?php

class dizidenXmlye{

var $dizi = [];

var $xml = '';

function dizidenXmlye($dizi){

$this->dizi = $di...

Etiket Bulutu

Time 13

Translate 12

Password 10

Array 9

Load Time 8

Date 8

Security 7

Get 7

Php 7

Html 7

Encrypt 7

Regular Expression 6

Class 6

Page Load 6

Xml 6

Mysqli 6

Database 6

Decrypt 6

Loading 6

Hesaplama 5

Wordpress 5

Files and Folders 5

Exchange 5

Diff 5

Mysql 5

Facebook 4

Google 4

Youtube 4

Responsive 4

Veritabanı 4

Browser 4

Session 4

Post 4

Error 4

Time Difference 4

Form 4

sinif 4

Random Password 4

Generator 4

String 4

Request 4

Random 4

Page Load Time 4

Currency 4

Language 4

Etiket 3

Sayaç 3

Türkçe 3

Sef Link 3

Link 3

Seo 3

Internet Explorer 3

Redirect 3

Input 3

Hex 3

Url 3

Domain 3

Extract 3

Cookie 3

Convert 3

JSON 3

Key 3

Css 3

call 3

Password Generator 3

Generate 3

Sql 3

Word 3

List 3

Text 3

Çeviri 3

Money 3

File 3

Day 3

Check 3

Hash 3

Secure 3

Year 3

Sanitize 3

Port 3

ID 2

Geçen Süre 2

Anlık 2

Kullanıcı 2

Renkli 2

Başlat 2

Durdur 2

Eklentisiz 2

Bootstrap 2

Web 2

Benzer 2

Güvenlik 2

Sorgu 2

Google Map 2

Koordinat 2

Excel 2

Sql Injection 2

İsim 2

Select 2

Edit 2